Gartner:看穿生成式AI的“炒作”,审视AI技术为企业带来的真正价值

来源: 赛博研究院

新的工具和技术都为企业业务增长和成本控制提供了新的机会。类似ChatGPT这样的工具,未来将有极大可能渗透、辐射并完全重新定义员工体验、客户体验、业务和IT的运营业务,以及企业的核心产品或服务建设。研讨会中,Gartner指明了ChatGPT和AIGC产业对中国企业影响的十个事实如下:

本文将聚焦“ChatGPT与LLM、生成式AI的关系,人工智能实施的三大障碍,部署类ChatGPT对于企业有哪些风险,企业如何利用类ChatGPT这个机会提升员工技能/数据分析水平以及Gartner如何看待AIGC未来的走向”几个方面,展开进一步的讨论。

ChatGPT与LLM、生成式AI的关系

弄清生成式AI定义

生成式AI(Generative AI)——生成式AI是指人工智能技术从数据和模型中学习工件的组件(要素),并利用它生成全新的、完全原创的工件(一个产品或物品或任务),同时保持与原始数据或模型的相似性。

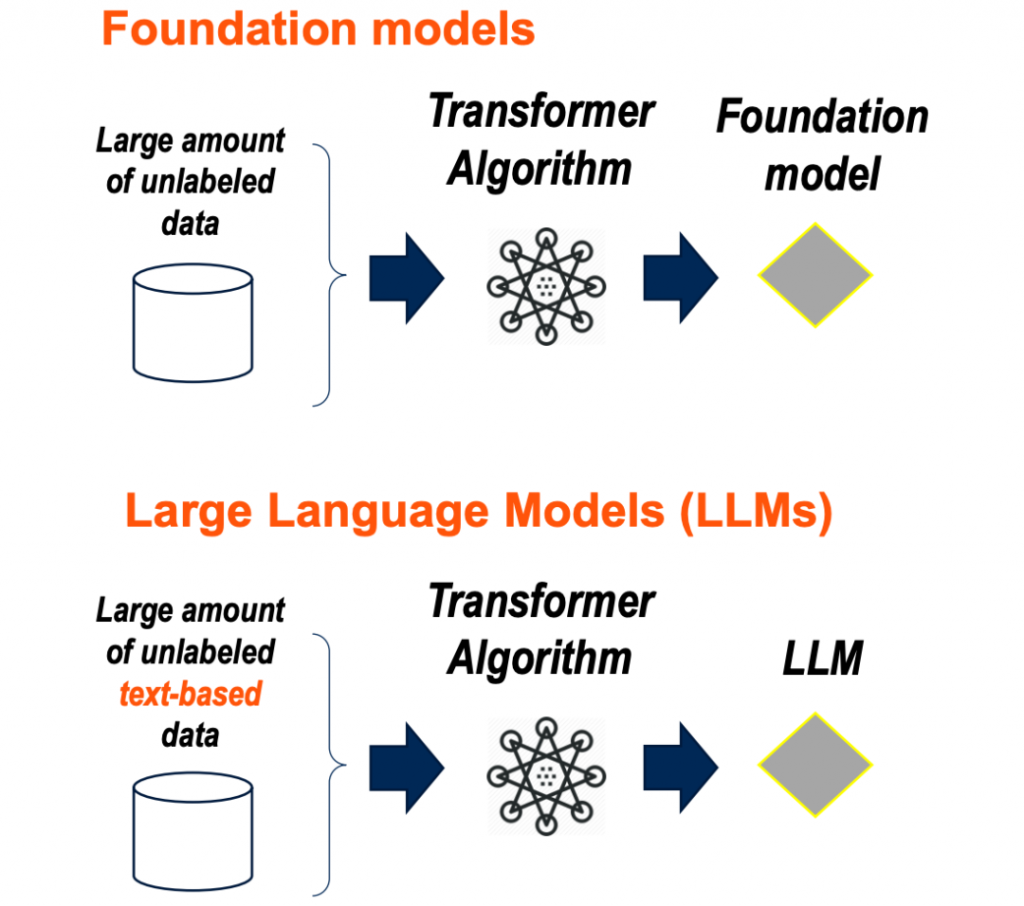

基础模型(Foundation model)——基础模型是一种大型的机器学习模型,使用转换器算法在大量无标记数据上进行训练;这种训练通过一系列微调(适配器)机制进行增强,从而产生一种可适用于各种应用的模型。

大语言模型(LLM)——LLM是一种专门针对自然语言的基础模型。

ChatGPT是一个建立在 LLM(这里指OpenAI的GPT模型)之上的会话应用程序。

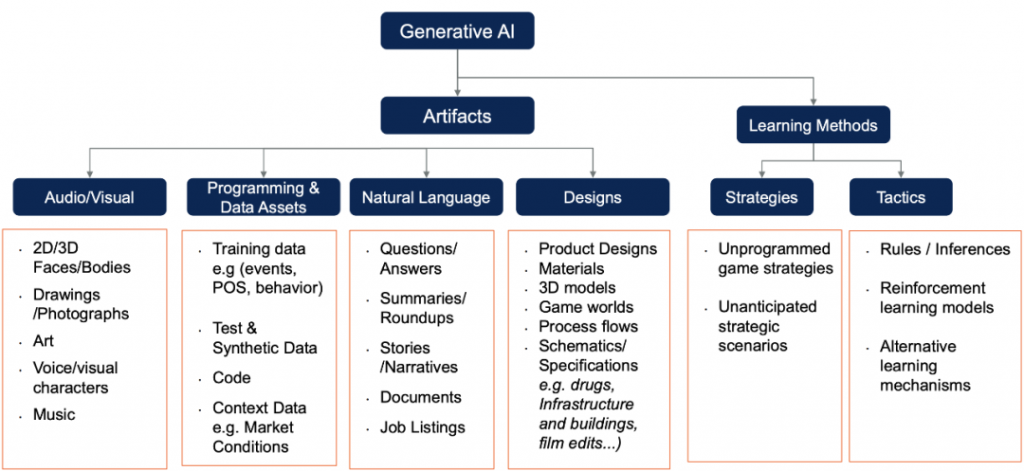

生成式AI还能生成什么?

生成式AI生成的内容大致可以分为产品与学习方法两大类。产品涉及音视频、编程与数据资产、自然语言、设计等领域;学习方法则主要包含战略、策略两个方向的内容。

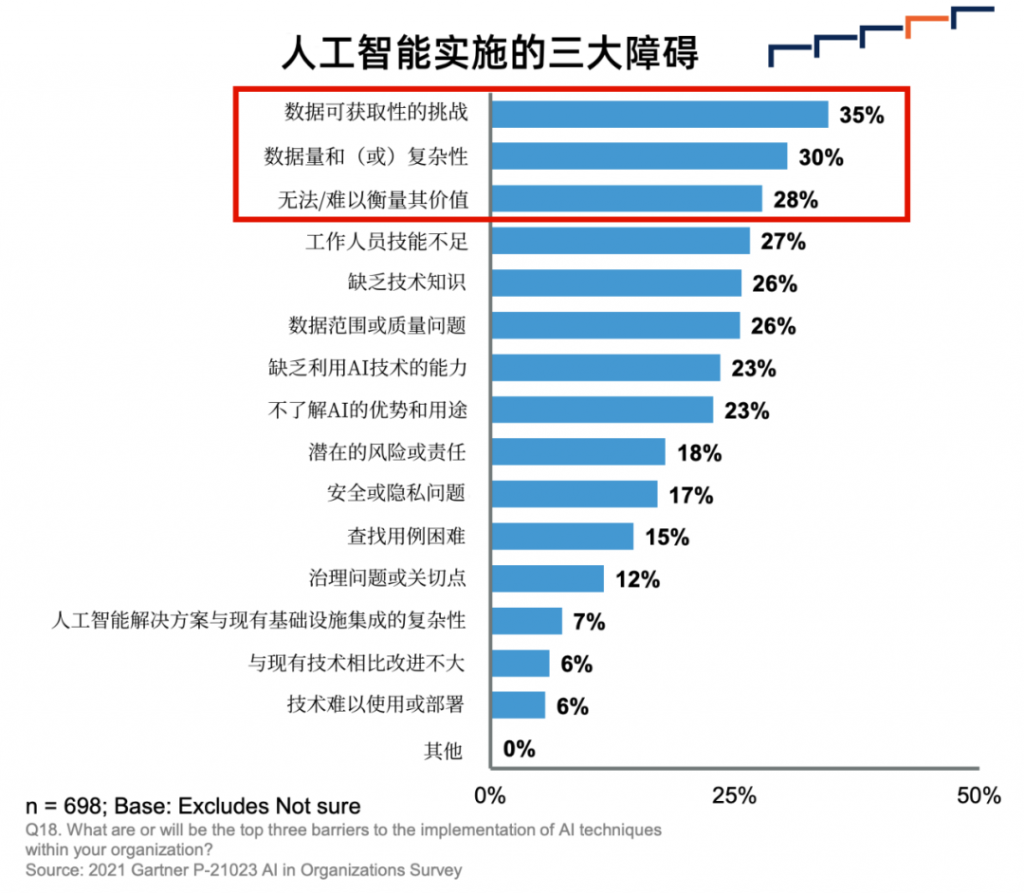

AI实施的三大障碍

Gartner调查了AI技术在企业中使用所面临的障碍。根据报告,AI技术实施最大的障碍包括数据可获取性的挑战、数据量和(或)复杂性、无法/难以衡量其价值。

企业部署类ChatGPT面临的风险

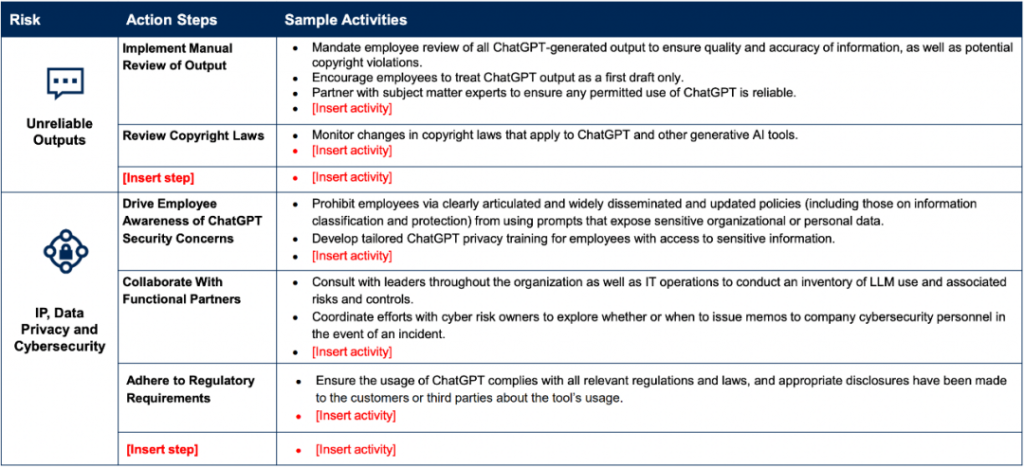

Gartner将部署类ChatGPT的技术会给企业带来的风险主要分为了输出不可信和知识产权、数据隐私与网络安全两大类。两类风险的具体体现如下。

风险一:用户面临的ChatGPT输出常见风险

1、事实不准确(Factual Inaccuracies):在重要细节上出错,输出的内容存在不真实性。

2、幻觉(Hallucinations):完全捏造的输出。对内容没有实际的 “理解”;它只是预测文本。

3、过时信息(Outdated Information):ChatGPT的“知识”截止日期为2021年9月。

4、偏见信息(Biased Information):训练数据的偏见会导致输出结果的偏差。

5、侵犯版权(Copyright Violations):输出结果可能与受版权保护的作品相似。

风险二:知识产权、数据隐私与网络安全

ChatGPT使用风险缓解的行动计划

企业如何利用类ChatGPT提升员工技能/数据分析水平

Gartner预测,到2030年,90%的数据工程师、数据与分析内容创建者和业务分析师将被“数据GPT”所取代。

提示工程将成为释放生成式AI价值的重要技术。从输入的角度,提示工程可以嵌入企业已有的知识并为大语言模型设置背景;从输出的角度,提示工程可以为输出结果做好安全的保证以及促进正确答案的生成。

提示工程(Prompt engineering)是一种人机交互设计的方法,它在计算机系统或应用程序中为用户提供相关提示、建议或反馈信息。这些提示信息可以帮助用户更好地理解系统的功能和如何与系统进行交互,从而提高用户的使用体验和效率。

普通群体可以学习提示工程技术,来改变一些提示词;而专业群体则通过精进LLM微调技术,改变整个模型。

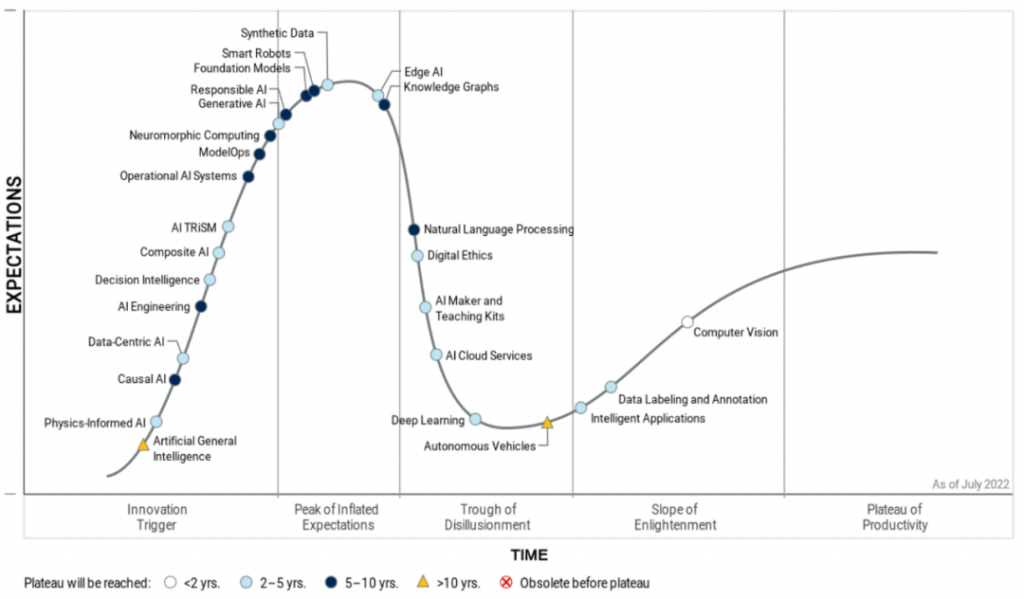

AI相关技术成熟度曲线

想要做大模型训练、AIGC落地应用、使用最新AI工具和学习AI课程的朋友,扫下方二维码加入我们人工智能交流群